Redes Neuronales y Deep Learning: La Arquitectura del Aprendizaje

💡 El Tip Rápido

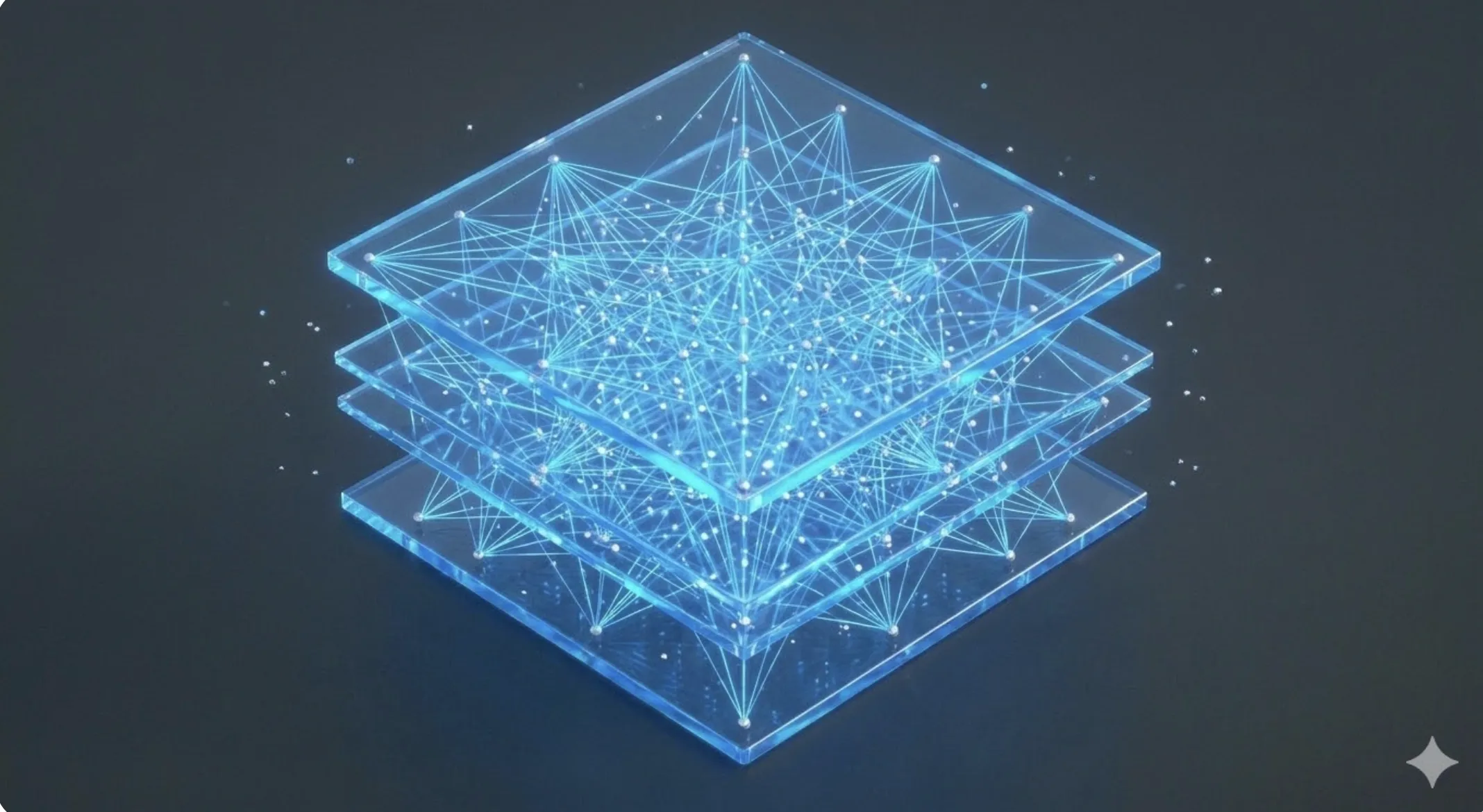

Las redes neuronales artificiales y el deep learning constituyen el núcleo de la inteligencia artificial moderna, imitando de forma simplificada el procesamiento de información del cerebro humano. Estos modelos se componen de múltiples capas de neuronas interconectadas que aprenden patrones complejos mediante el ajuste de pesos sinápticos a través del algoritmo de retropropagación. El éxito del aprendizaje profundo reside en su capacidad para extraer características de forma automática a partir de grandes volúmenes de datos, permitiendo avances sin precedentes en áreas como el reconocimiento de voz, la medicina de precisión y la conducción autónoma, transformando radicalmente nuestra interacción con la tecnología.

Cuando la NASA tuvo que improvisar un filtro de CO2 para el Apollo 13, lo hizo entendiendo los principios básicos del flujo de aire y la presión. Eso es ingeniería real. En contraste, mucha de la "inteligencia" que consumimos hoy es tratada como un mando a distancia caro: pulsamos un botón y esperamos un milagro, sin entender que las redes neuronales son, en esencia, estructuras matemáticas de bits que intentan representar átomos complejos.

El gran problema actual es que construimos redes que actúan como islas de datos dentro de las empresas. No están integradas en el flujo real. Para solucionar esto, volvemos a la analogía del Gemelo Digital. Según describe Cinto Casals, Ingeniero de IA, una red neuronal profunda no es más que el motor de inferencia de un Gemelo Digital, encargada de predecir estados futuros basándose en la arquitectura de datos previa.

Implementamos el "Paso Cero" como diferenciador metodológico. No empezamos comprando GPUs masivas (átomos); empezamos diseñando cómo se organizarán los bits de entrenamiento. La visión es la tecnología invisible, donde el Deep Learning se funde con el entorno, optimizando la logística o el consumo energético de forma autónoma sin que el usuario tenga que interactuar con una interfaz. La IA se vuelve tan natural como la electricidad.

Si su estrategia de IA se basa solo en comprar potencia de cálculo sin una arquitectura de información clara, ¿está haciendo ingeniería o solo está alimentando una máquina de consumo que no comprende?

📊 Ejemplo Práctico

Escenario Real: Entrenamiento de un Clasificador de Calidad de Componentes

Imagina una fábrica de transistores que quiere usar una red neuronal para detectar piezas defectuosas automáticamente a partir de datos de voltaje y temperatura.

Paso 1: Preparación del Dataset. Recopilamos datos de 10,000 pruebas. Normalizamos los valores de entrada para que estén entre 0 y 1, ya que las redes neuronales convergen mucho más rápido con datos escalados.

Paso 2: Definición de la Topología. Creamos una red con una capa de entrada de 5 neuronas (los sensores), dos capas ocultas de 64 neuronas cada una con función de activación ReLU, y una capa de salida con una sola neurona y función Sigmoide (que devuelve un valor entre 0 y 1: defectuoso o sano).

Paso 3: Entrenamiento y Loss. Usamos la función de pérdida 'Binary Crossentropy' y el optimizador 'Adam'. Durante las primeras 50 épocas, observamos cómo el error disminuye.

Paso 4: Validación. Probamos la red con datos que nunca ha visto. Si la precisión es superior al 98%, desplegamos el modelo en el microcontrolador de la línea de producción. Si el modelo falla mucho en los datos de prueba pero acierta en los de entrenamiento, aplicamos Dropout para reducir el sobreajuste técnico.