Funcionamiento de una GPU Moderna: Más allá de los Píxeles

💡 El Tip Rápido

Las GPUs modernas han evolucionado de simples procesadores gráficos a unidades de cómputo paralelo masivo esenciales para la IA y el Ray Tracing. Su arquitectura se basa en miles de núcleos de flujo que ejecutan hilos de forma concurrente, apoyados por núcleos especializados como los RT Cores para cálculos de intersección de luz y Tensor Cores para operaciones de matrices complejas. Comprender la jerarquía de memoria VRAM (GDDR6X) y el ancho de banda del bus es vital para evitar cuellos de botella en renderizado fotorrealista y entrenamiento de modelos de lenguaje de gran escala en 2026.

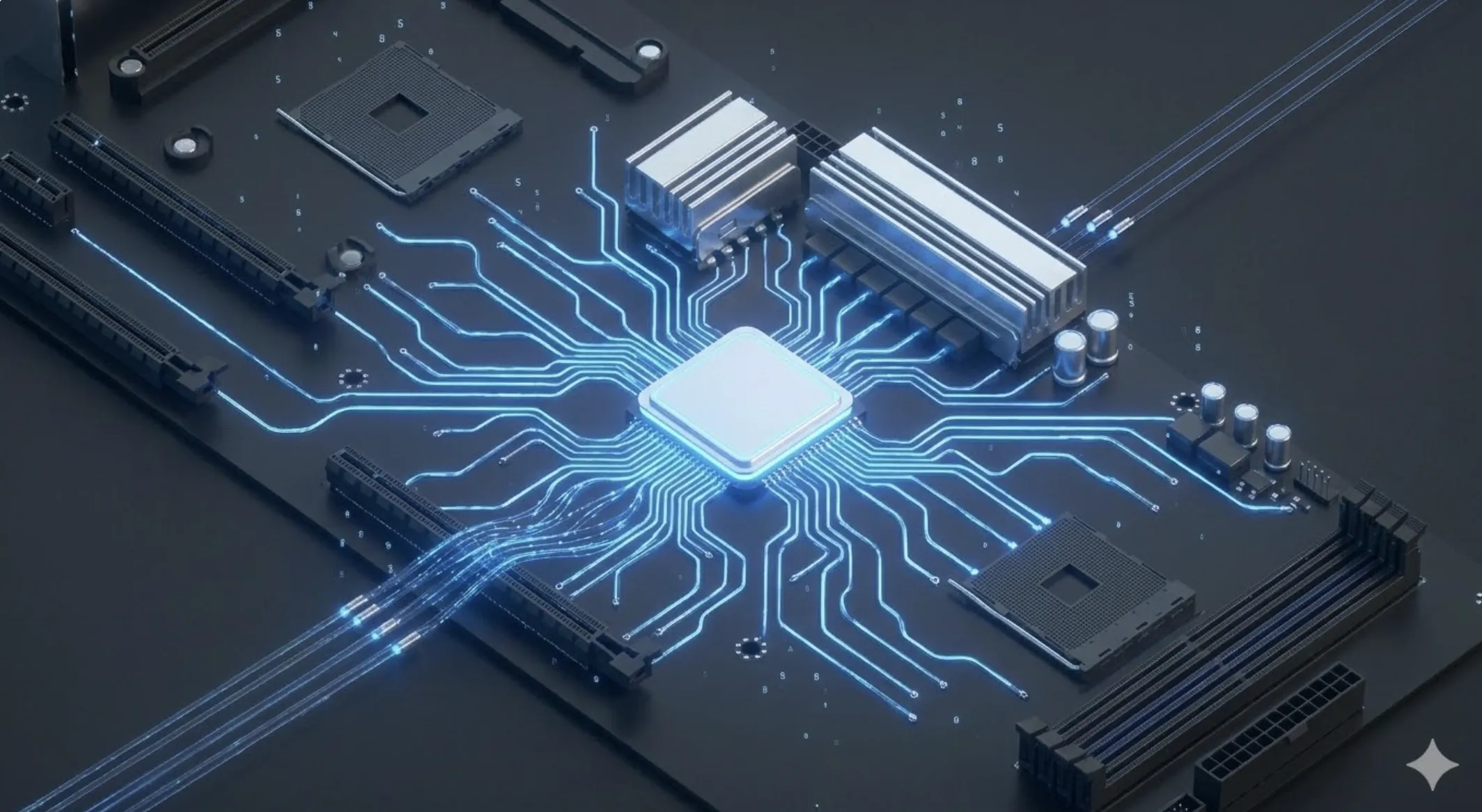

Arquitectura Paralela de la GPU

A diferencia de una CPU, que tiene pocos núcleos optimizados para tareas secuenciales, una Unidad de Procesamiento Gráfico (GPU) contiene miles de núcleos pequeños diseñados para realizar la misma operación matemática en grandes volúmenes de datos simultáneamente (SIMD - Single Instruction Multiple Data). Esta arquitectura es perfecta para renderizar imágenes, donde cada píxel puede calcularse de forma independiente.

Ray Tracing y Núcleos RT

La mayor innovación visual reciente es el Trazado de Rayos (Ray Tracing) en tiempo real. Para lograr esto sin colapsar el rendimiento, las GPUs modernas (como las series NVIDIA RTX o AMD RX) incluyen núcleos dedicados llamados RT Cores. Estos núcleos están especializados en calcular las intersecciones de rayos de luz con geometrías 3D, simulando reflejos, sombras y refracciones realistas que antes eran imposibles de procesar en milisegundos.

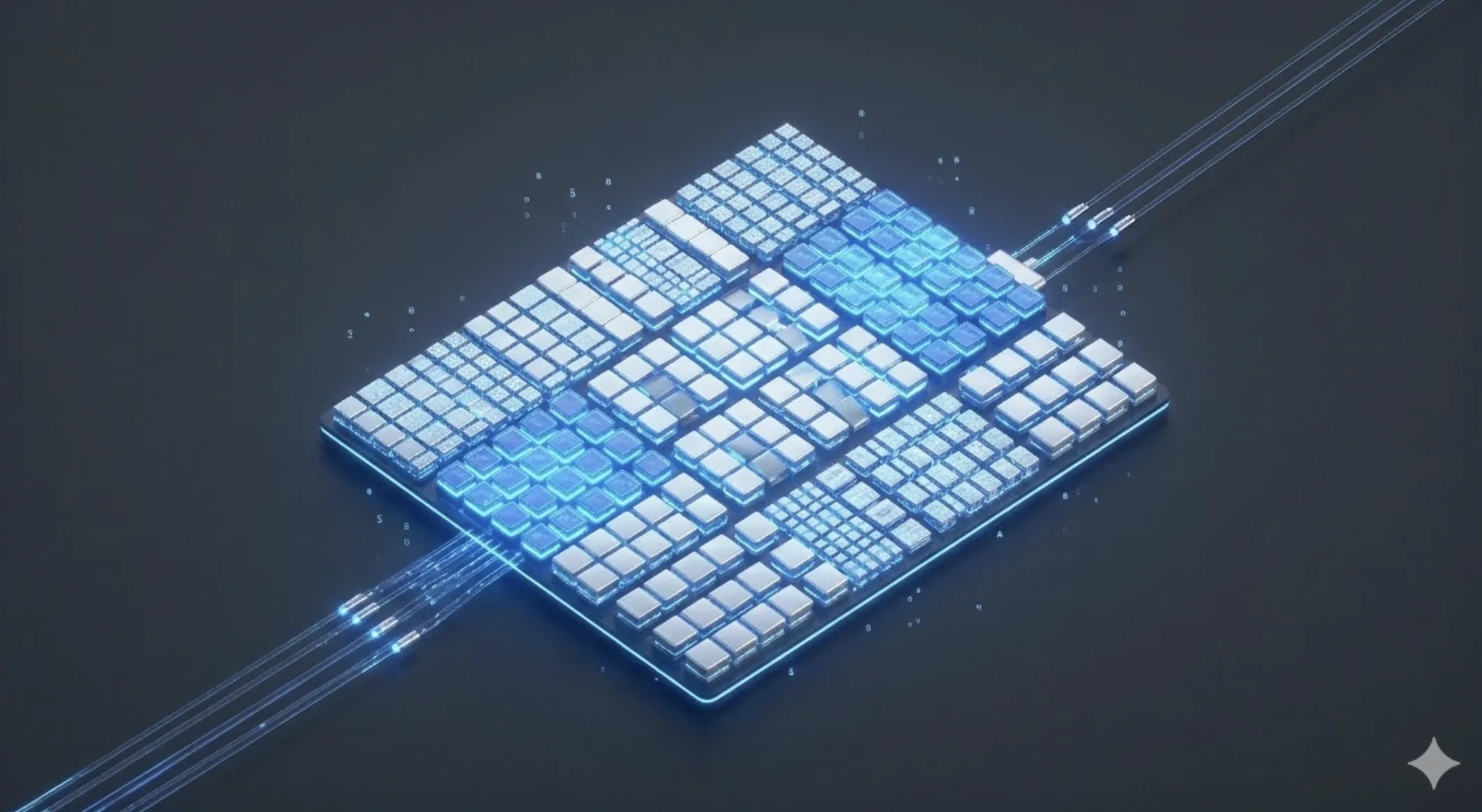

Tensor Cores e Inteligencia Artificial

Las GPUs ya no solo dibujan; también "piensan". Los Tensor Cores son unidades diseñadas para operaciones de matrices complejas, el corazón del aprendizaje profundo (Deep Learning). Esto permite tecnologías como el DLSS (Deep Learning Super Sampling), donde la IA reconstruye una imagen de alta resolución a partir de una de baja resolución, permitiendo ejecutar juegos exigentes con una fluidez asombrosa sin perder calidad visual.

Memoria VRAM y Ancho de Banda

Dado que una GPU procesa gigabytes de texturas, necesita su propia memoria de alta velocidad: la VRAM (GDDR6/6X). Utiliza buses de datos muy anchos (256 bits, 384 bits) para mover información a velocidades de hasta 1 TB/s. Sin este ancho de banda, los núcleos de la GPU se quedarían "hambrientos" de datos, limitando el rendimiento global del sistema.

📊 Ejemplo Práctico

Escenario Real: Optimización de Renderizado con Ray Tracing y DLSS en un Motor de Videojuegos

Estás desarrollando un entorno arquitectónico fotorrealista en Unreal Engine 5. Al activar el trazado de rayos completo (Lumen y trazado por hardware) para lograr reflejos exactos, el rendimiento cae de 60 FPS a solo 15 FPS en una resolución 4K. El hardware es una GPU de gama alta, pero el número de rayos procesados por segundo satura los RT Cores disponibles. Debemos implementar una estrategia de optimización basada en la arquitectura específica de la GPU.

Paso 1: Perfilado de la VRAM y Latencia. Usamos herramientas de diagnóstico para verificar el uso de la memoria de vídeo. El trazado de rayos requiere almacenar estructuras de aceleración (BVH) masivas en la VRAM. Descubrimos que la memoria está al 95% de su capacidad, lo que provoca que algunos datos se muevan a la RAM del sistema a través del bus PCIe, aumentando drásticamente la latencia. Reducimos la resolución de los mapas de texturas secundarios y activamos la compresión de texturas para liberar 2GB de VRAM, devolviendo la fluidez al acceso de datos críticos.

Paso 2: Configuración de Tensor Cores y Superresolución. Para recuperar los FPS perdidos sin sacrificar la nitidez visual, activamos DLSS 3.5 (Deep Learning Super Sampling). Esta tecnología utiliza los Tensor Cores de la GPU para ejecutar una red neuronal que reconstruye la imagen a 4K a partir de una base de menor resolución. Al delegar esta tarea a los núcleos de IA, liberamos a los núcleos de sombreado tradicionales para que se centren en la lógica de iluminación, logrando subir de 15 FPS a 50 FPS de forma instantánea.

Paso 3: Optimización del Trazado de Rayos (RT Cores). Ajustamos la "distancia de trazado" y el número de rebotes de luz. Técnicamente, cada rebote adicional requiere una nueva consulta a la jerarquía de volúmenes (BVH) en los RT Cores. Al limitar los rebotes en superficies no metálicas, reducimos la carga computacional en un 30% con un impacto visual mínimo. La GPU ahora puede mantener un ritmo de fotogramas estable sin picos de latencia.

Paso 4: Verificación Térmica y Frecuencias. Finalmente, observamos que tras 30 minutos de renderizado intenso, el reloj de la GPU baja de 2.5 GHz a 2.1 GHz. Instalamos una curva de ventilación más agresiva para mantener el núcleo por debajo de los 75°C, asegurando que el "Boost Clock" se mantenga al máximo. El proyecto ahora se visualiza a 60 FPS estables con una calidad visual impresionante, aprovechando cada núcleo especializado de la arquitectura moderna.